Hasta Elon Musk lo admite. Recientemente, el nuevo dueño de Twitter compartió un meme en el que insinúa que la pornografía dominará la Inteligencia Artificial (IA), como lo hizo con cada innovación tecnológica. Pero lejos de ser algo gracioso, es una situación que implica nuevas formas de violencia de género.

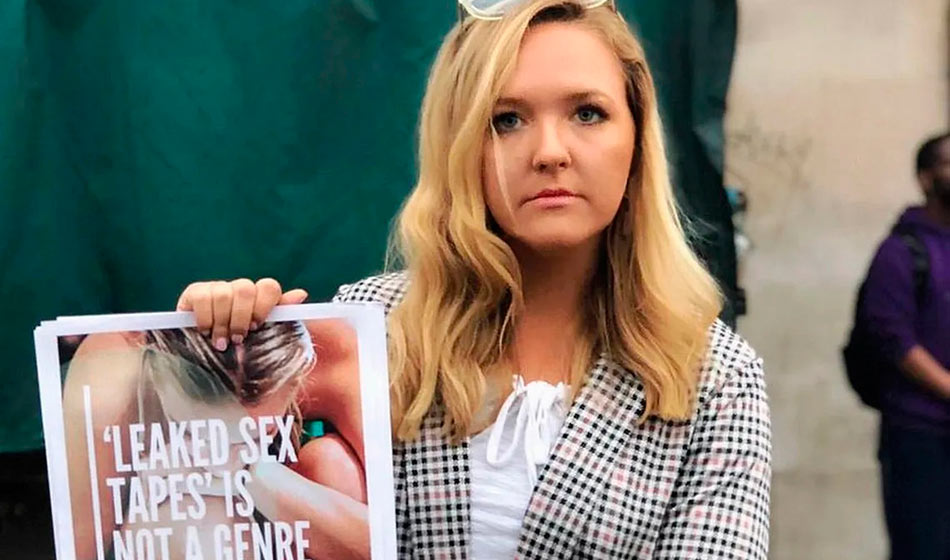

Como si fuera poco, en materia legislativa todavía queda mucho por recorrer. Las formas de violencia contra la mujer en medios digitales tienen poca legislación a lo largo del mundo. Por esta razón, los avances tecnológicos requieren de una actualización urgente.

En este sentido, en las últimas semanas fueron noticia los deepfake porno. La periodista Lauren Barton descubrió videos sexuales con las caras de las actrices Emma Watson y Scarlett Johansson en cuerpos de otras personas.

Sin embargo, no fueron las únicas víctimas. En enero de este año, en la plataforma Twitch, el streamer Atrioc fue descubierto viendo porno generado con IA de otras mujeres streamers.

El mayor problema radica en que estos materiales se realizan por usuarios de Internet desconocidos, sin el consentimiento de las involucradas. De este modo, las mujeres desconocen la existencia de estos videos y, por lo tanto, no pueden hacer nada para evitarlos.

¿Qué es un deepfake porno?

La técnica del deepfake se basa en la IA para manipular cuerpos y caras en un video, logrando que parezcan los de otra persona. A veces, toma los gestos y las palabras de un individuo y los cambia al antojo de su creadore, para que digan o hagan algo que nunca realizaron.

En 2018, el medio estadounidense Vox se hizo eco de un estudio que reveló que el 96% de los deepfakes analizados eran de contenido pornográfico de mujeres. La mayoría famosas, y los vídeos fueron confeccionados sin su consentimiento.

La palabra deepfake es un acrónimo de “deep learning” (“aprendizaje profundo”) y “fake” (“falso”). De hecho, el término surgió en el foro Reddit en 2017, cuando un usuarie que utilizaba ese nombre empezó a subir vídeos en los que sustituía la cara de actores reales por las de otres.

Había algunos de Nicolas Cage pero, sobre todo, se trataban de vídeos pornográficos con las caras de las actrices Gal Gadot, Emma Watson y Scarlett Johansonn; las cantantes Taylor Swift y Katy Perry; y otras personalidades públicas como Kate Middleton, Michelle Obama o Ivanka Trump.

Intentos de regulación

En 2018, Reddit expulsó a dicho usuarie, pero el daño ya estaba hecho. Ello se debió a que esta modalidad de uso de la IA para generar violencia sexual se diseminó en el mundo.

Después de las polémicas, las empresas de redes sociales intentan controlar el asunto. Twitch hizo lo suyo luego de que el streamer Brandon “Atrioc” Ewing retransmitiera imágenes explícitas de mujeres desnudas con los rostros de populares streamers mujeres.

La plataforma anunció una actualización de sus políticas para luchar contra la pornografía deepfake. En este sentido, impuso sanciones como la suspensión indefinida de la cuenta de usuaries que “promuevan, creen o compartan” contenido relacionado con este tipo de imágenes.

Lo mismo sucedió en Meta. En las páginas web de la compañía, se viralizaron anuncios que promocionaban la app FaceMega. Esta pertenecía a Ufoto Limited, propiedad de una empresa matriz china, Wondershare. Las publicidades mostraban los rostros de Emma Watson y Scarlet Johansson en videos sexuales junto a la leyenda: “Reemplaza la cara con cualquiera”.

Luego del repudio, Meta dio de baja dichas publicidades. “Nuestras políticas prohíben el contenido para adultos, independientemente de si es generado por IA o no, y hemos restringido esta página de publicidad en nuestra plataforma”, expresó un portavoz de la empresa.

Pero, ¿estos “castigos” solo dependen de las compañías que manejan redes sociales? ¿Quién contiene a las víctimas de violencia sexual digital? Los Estados en diferentes partes del mundo, ¿tienen legislación que contemple estos casos?

La violencia sexual digital en Argentina

En Argentina, si bien se promueve desde el Estado el uso de IA, aún no hay regulaciones que controlen los diferentes problemas que podría generar esta tecnología. De hecho, según informó argentina.gob.ar, el año pasado se realizó un seminario llamado “Regulación de las inteligencias artificiales: análisis de sus aspectos éticos, políticos y jurídicos”. En él se problematizó cómo debería legislarse esta herramienta.

Mientras tanto, los casos de violencia sexual digital continúan, y el deepfake porno también sucede en el país. Al respecto, en 2022 se presentaron dos proyectos que aún no son ley para regular estas situaciones.

Una de ellas es la “Ley Olimpia”. La misma propone incorporar la violencia digital como otra forma de violencia contra las mujeres en el marco de la Ley 26485. También, incorporar al Código Penal los delitos de obtención y difusión no consentida de material íntimo y/o de desnudez, de los “porn deep fake” y de la “sextorsión”.

La otra es la “Ley Belén”, que se denomina así en honor a Belén San Román, se quien se suicidó luego de que su expareja viralizara contenido íntimo sin su consentimiento. La norma establecería modificaciones en el Código Penal de la Nación para prever penas de prisión de tres meses a tres años y elevar las multas establecidas.

Estos castigos serían para quienes “por cualquier medio, sin autorización de la víctima o mediando engaño, videograbe, audiograbe, fotografíe, filme o elabore, documentos con contenidos de desnudez, naturaleza sexual o representaciones sexuales explícitas”.